C’est une première. Le 1er mai dernier, près de 200 employés œuvrant dans l’ombre des géants de la tech OpenAI, Meta ou encore ByteDance – respectivement propriétaires de l’agent conversationnel ChatGPT et des réseaux sociaux Facebook et TikTok – ont annoncé la création d’un syndicat africain des modérateurs de contenu. Employés par des entreprises sous-traitantes, ils réclament une revalorisation de leurs conditions de travail, qu’ils estiment "indignes".

Les modérateurs ont en effet pour mission d’analyser un grand nombre de publications afin d’éliminer les contenus problématiques, décrivant des scènes de pédophilie, de meurtre, de torture ou encore d’inceste, parfois pour moins de deux dollars de l’heure. Une prestation impliquant une lourde charge mentale, allant pour certains employés jusqu’à un état de stress post-traumatique.

"De TikTok à Facebook, ces personnes sont confrontées aux mêmes problèmes. Contenus toxiques, absence de soins de santé mentale, travail précaire – il s’agit de défaillances systémiques dans la modération des contenus", insiste auprès du Time

Martha Dark, Codirectrice de Foxglove, une association soutenant les salariés dans leurs procédures.

Un sous-traitant au cœur des controverses

Car la création du syndicat n’a rien eu d’un long fleuve tranquille. En 2019, Daniel Motaung, modérateur de contenu pour le compte de Facebook avait déjà tenté de lancer un mouvement de grève et de former un premier syndicat nommé Alliance. Alors employé par Sama, entreprise kényane spécialisée dans la modération pour les géants de la tech, qui affirme fournir un "travail digne aux personnes qui en ont besoin", sa démarche se solde par un licenciement.

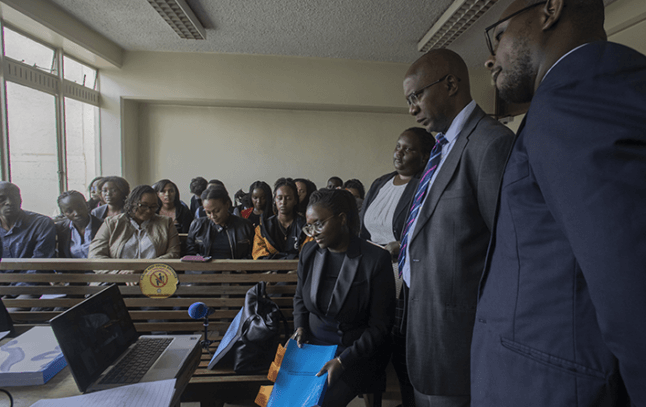

Deux ans plus tard, Daniel Motaung porte plainte contre son employeur, mais également contre Meta, pour dénoncer des conditions de travail mettant en danger la santé et la sécurité des travailleurs. Une procédure judiciaire suivie en mars 2023 par la plainte de près de 190 salariés, toujours contre Sama, pour licenciement "illégal car sans justification" selon les informations de l’AFP, alors que la société remerciait à nouveau 260 employés.

Vers une professionnalisation de la modération

Début 2023, Sama était par ailleurs au cœur d’une

enquête menée par le Time concernant son contrat avec OpenAI, entreprise spécialisée dans l’intelligence artificielle, à l’origine de ChatGPT. Des modérateurs kenyans avaient révélé au média américain avoir dû passer en revue des milliers de textes violents afin de développer le mécanisme de sécurité du chatbot, sans réel accompagnement psychologique.

"C’était de la torture", témoignait l’un d’entre eux au magazine. Un travail de fourmi qui a laissé les travailleurs traumatisés. Ces derniers ont ainsi annoncé leur volonté de rejoindre à leur tour le syndicat.

Les salariés appellent désormais à une meilleure reconnaissance de leur profession.

"Actuellement, les modérateurs sont considérés comme des sortes de citoyens de seconde classe alors que la modération est le cœur du business des plateformes", regrette

Daniel Motaung dans une interview accordée à France Culture en février 2023.

"Je crois profondément qu’une fois que la modération sera professionnalisée, nous serons en mesure d’être sûr qu’il y a moins d’exploitation, de moins en moins de modérateurs qui développent des symptômes de stress post-traumatiques car les réseaux sociaux seront devenus un lieu sûr."Florine Morestin